( AI )

Интеграция LLM, которая доезжает до прода

Подключаем большие языковые модели к вашему продукту — не как демо, а как продуктовую фичу. Каждое решение принимаем по критериям надёжности, стоимости и скорости.

RAG-пайплайн, дообученная модель или мультиагентная система — берём сложность на себя, чтобы ваша команда занималась продуктом.

AI, который встаёт

в ваш процесс

Встраиваем LLM в ваши продукты и процессы — не как трюк на демо, а как множитель силы для команды.

Автоматизация поддержки, внутренний поиск по знаниям — каждая интеграция проектируется под надёжность, стоимость и измеримый ROI.

Что умеем интегрировать

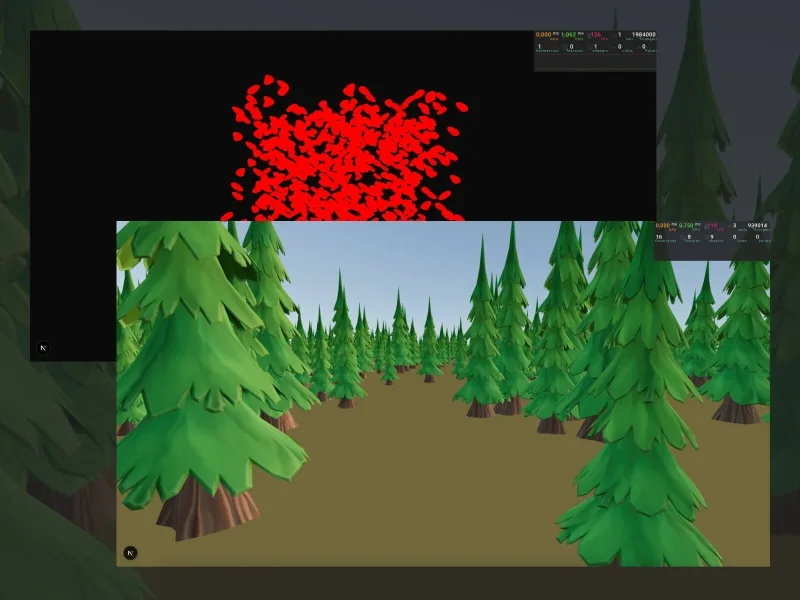

RAG-пайплайны

Retrieval-augmented generation на ваших данных. Векторный поиск, пайплайны эмбеддингов и атрибуция источников — ответы точны и их можно проверить.

Function calling

LLM, которые вызывают API, запрашивают БД и запускают воркфлоу по намерению пользователя. Собираем tooling-слой так, чтобы это было безопасно и надёжно в проде.

Fine-tuning и оценка

Доменный fine-tuning с автоматической оценкой качества. Каждое изменение промпта или модели проходит бенчмарки по точности, latency и стоимости.

Результаты

интеграции

Наши интеграции LLM выходят быстрее и обходятся дешевле, чем разработка in-house. Продакшн-надёжность и latency ниже 200 мс на любом масштабе.

Каждый деплой мониторится по точности, стоимости и производительности — ROI виден с первого дня.

От архитектуры

до продакшна

Структурированный путь от выбора модели до живого деплоя. Берём на себя сложность prompt engineering, RAG-пайплайнов и боевой стабилизации.

На каждом шаге — бенчмарки оценки, чтобы до выхода к пользователям точно знать, как система себя ведёт.

Выбираем один сценарий

Фиксируем один процесс, заслуживающий автоматизации, прописываем метрику успеха и согласуем бюджет по токенам, latency и допустимой ошибке — до первой строки кода.

Промпты, retrieval и инструменты

Шаблоны промптов в version control, retrieval, настроенный на размеченном датасете, tool-слой со строгими схемами. Каждое изменение проходит eval-пайплайн.

Офлайн и онлайн evals

Golden-датасеты, LLM-as-judge на тонких кейсах и дашборды по живому трафику. Ловим регрессии раньше, чем их заметят пользователи.

Выкат за kill switch

Канареечный раскат на 5% трафика, автоматический откат при нарушении guardrail-ов и runbook, по которому дежурный реально разберётся в 2 часа ночи.

Прозрачные цены

Фикс-прайс для чётко очерченного объёма, T&M — для непрерывной работы. Никаких скрытых комиссий и неожиданных счетов: каждый проект начинается с прозрачного скоупа и бюджета.

Нужен MVP от 2 недель или полная продуктовая команда на год — подстроим формат под ваш этап, бюджет и амбиции.

Под вашу задачу

Интеграция LLM в ваш продукт

Prompt engineering · API-слой · Оптимизация стоимости · Guardrails

Корпоративный

всё в одном пакете — от исследования до продвижения

Ресёрч · Дизайн · Разработка · Продвижение